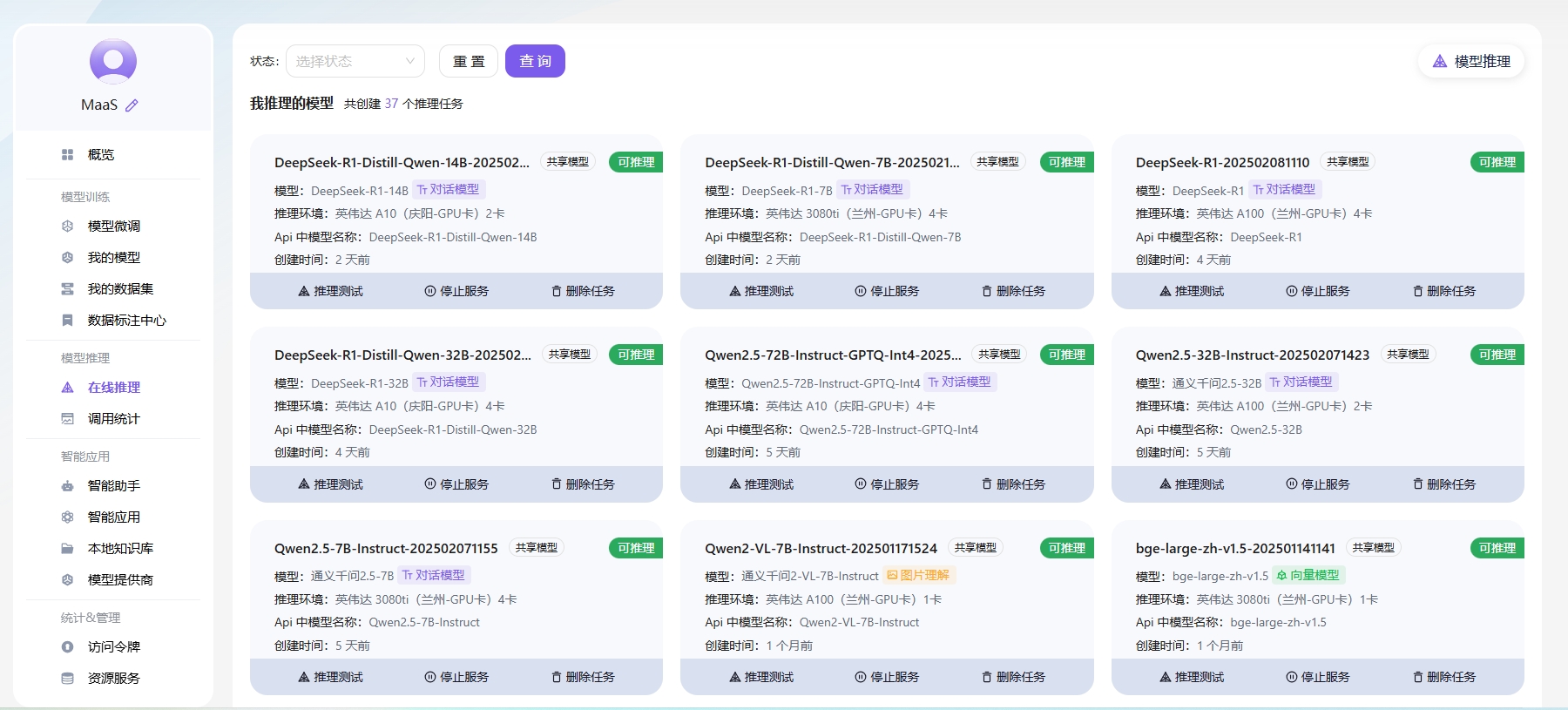

模型推理

在这里您可以将您的模型部署到一站式智算服务平台,进行推理验证以及推理过程数据监控;也可以通过标准OpenAI接口,将模型接入您的应用。

- ✅推理模型只需要三步:

第一步:找到自己想要的模型,点击下一步

第二步:选择算力资源,开始推理。

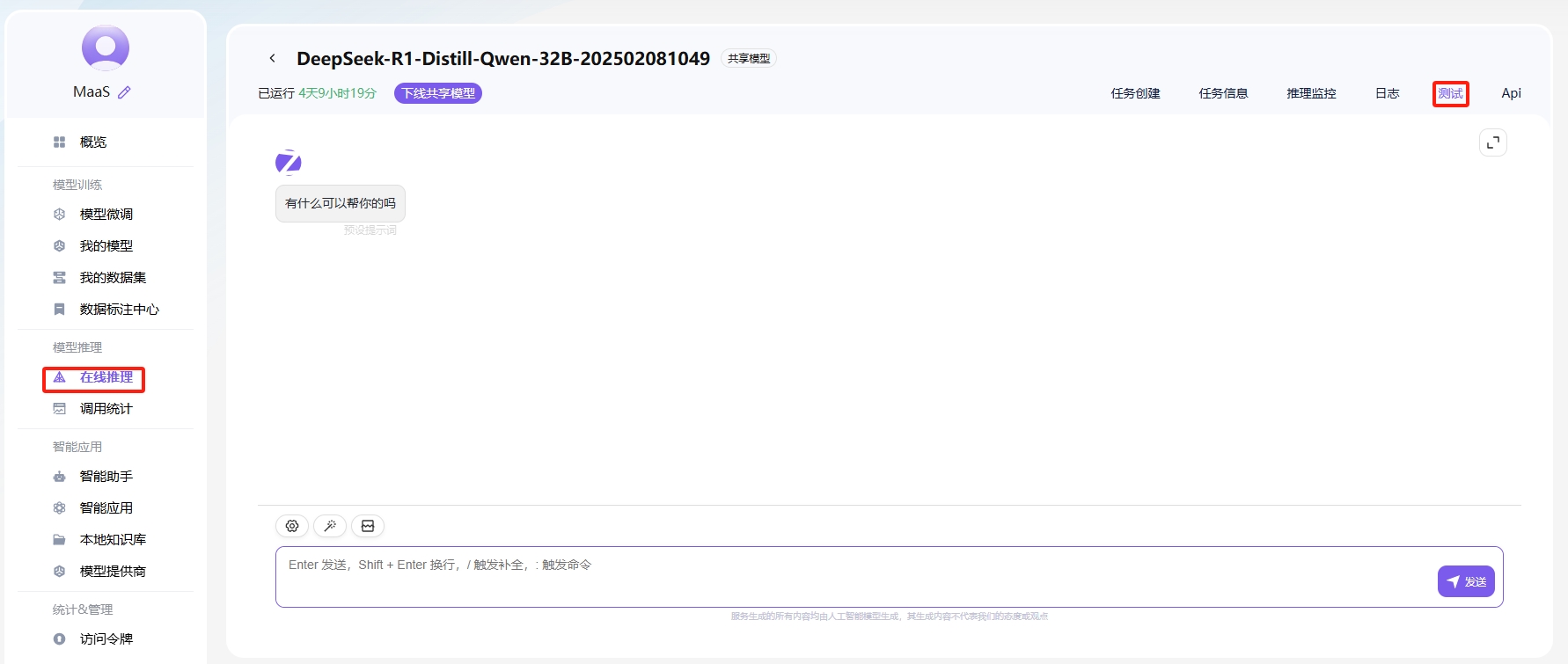

第三步:部署完成,点击测试。👉创建推理任务

✅ 选择模型

首先进行 “选择模型” 步骤,选定想要部署的模型。

✅ 选择算力

进入 “选择算力” 环节,当模型过大时,可开启显存虚拟化功能,页面上也显示已开启此功能。同时,能设置资源调度策略,指定实例数等,按照实例数和每个实例所需显存,自动化分配部署节点,还可设置部署实例数。完成这些设置后,可点击 “下一步” 继续后续部署流程。

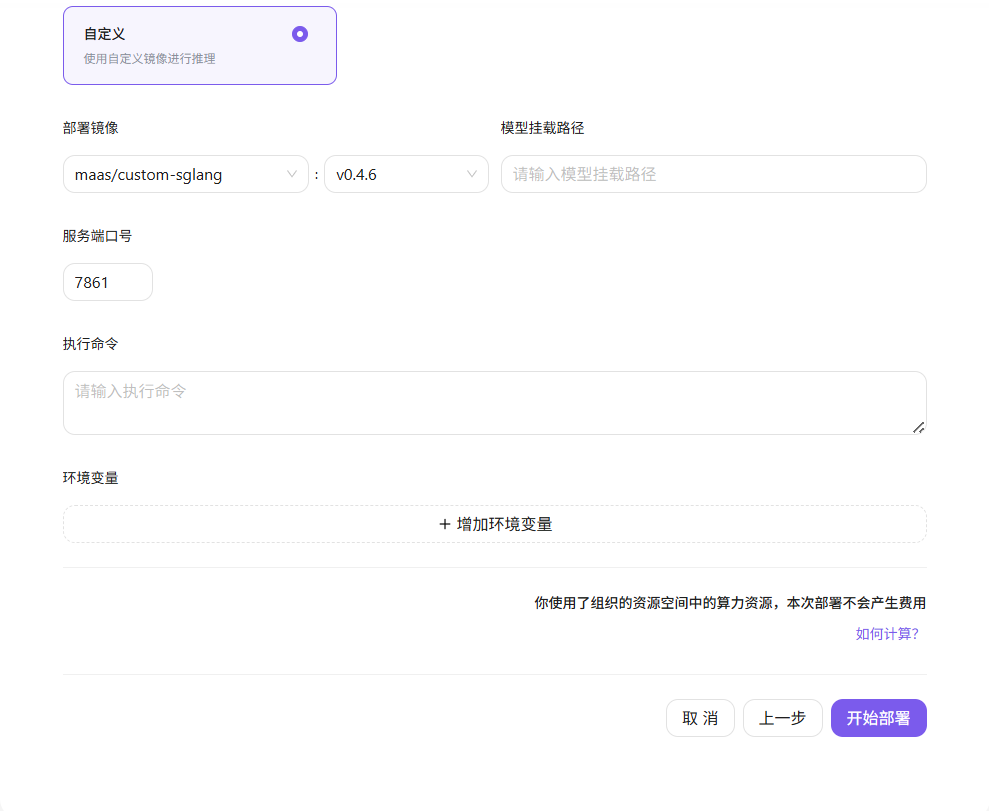

✅ 参数设置

在设置推理参数时可选择以下三种推理引擎:vLLM、SGLang、由华为研发的MindIE。

用户还可选择自定义设置参数,使用自定义镜像进行推理。同时,可选择部署镜像,设置部署参数,完成后可点击 “开始部署”。

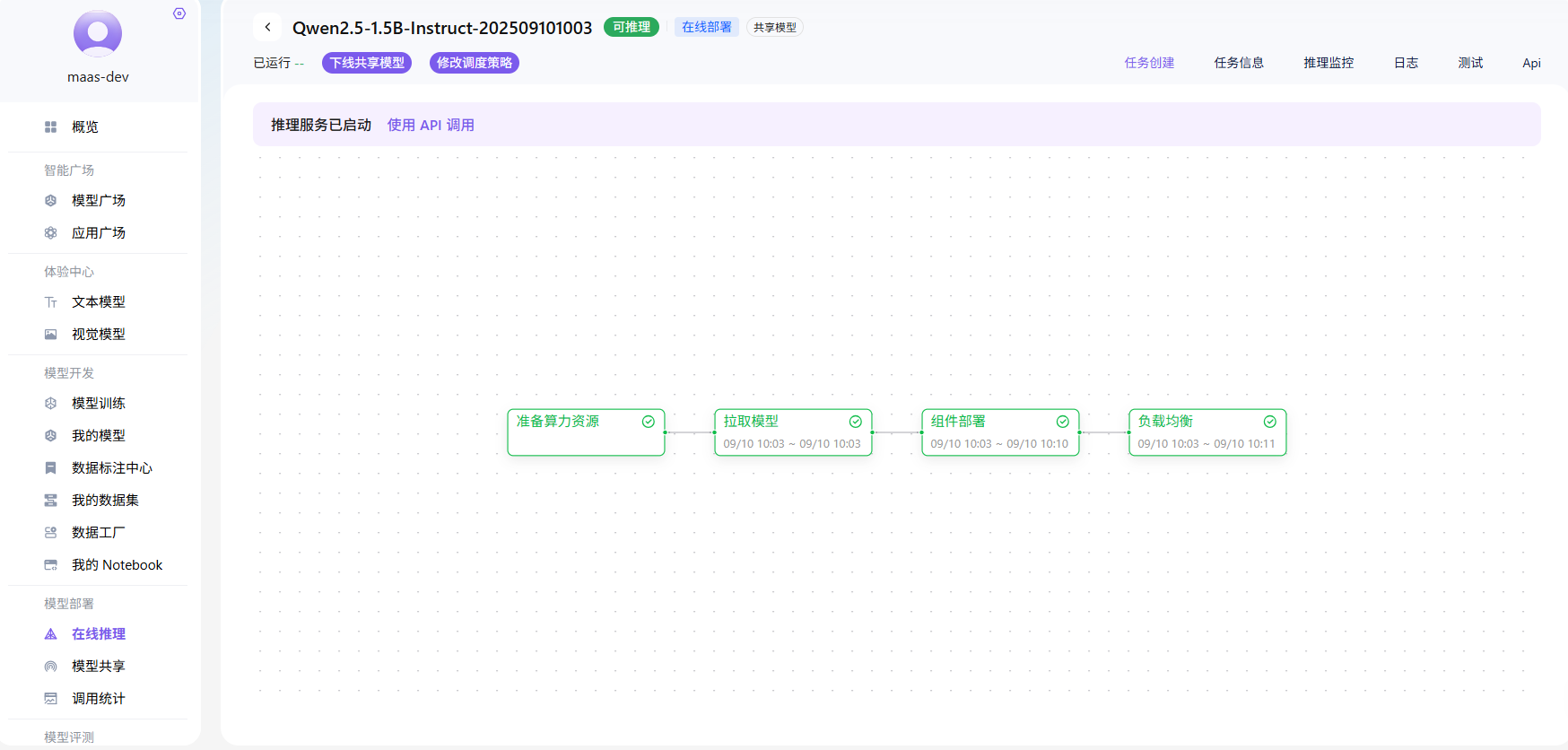

✅ 创建任务

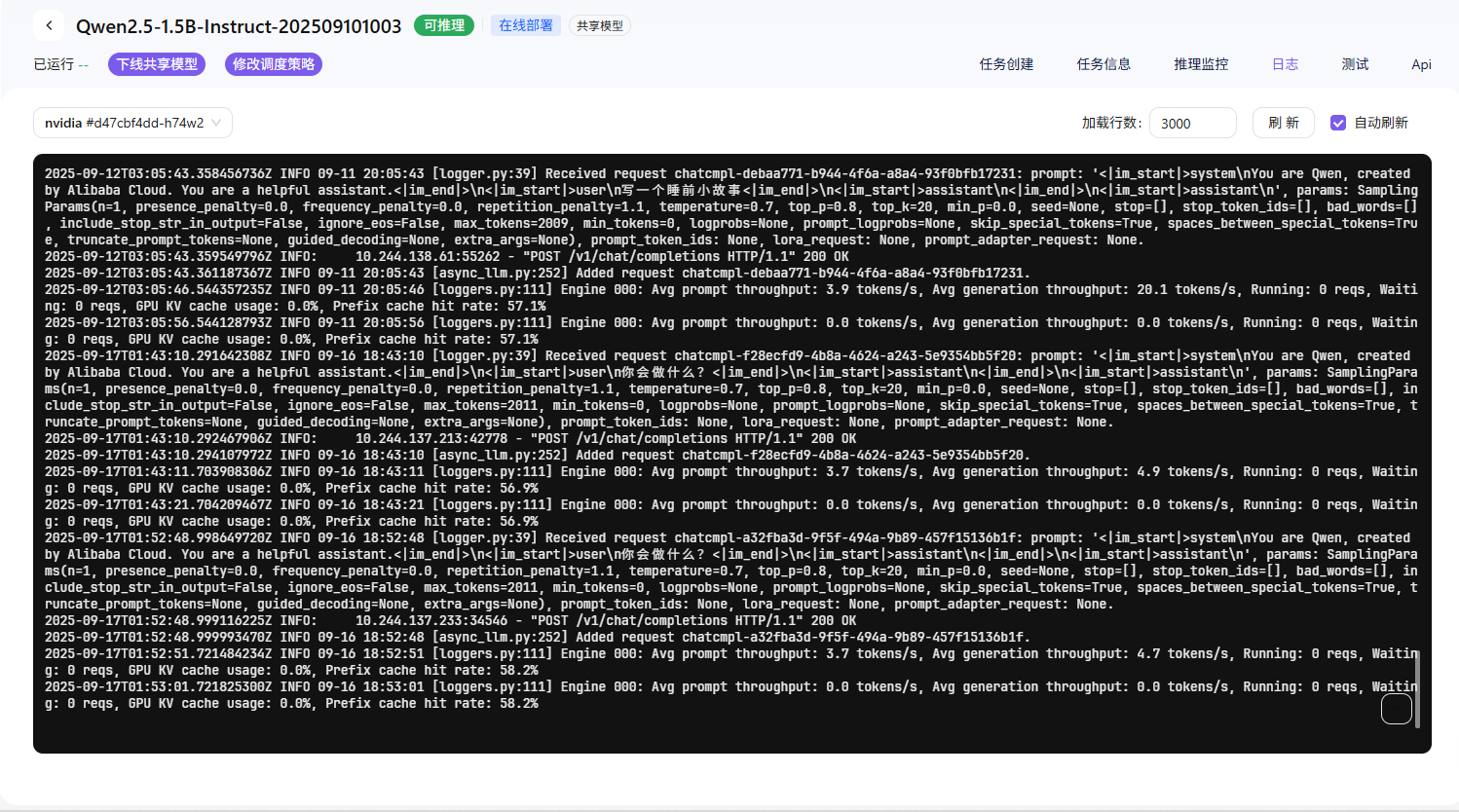

✅ 查看日志

👉推理测试

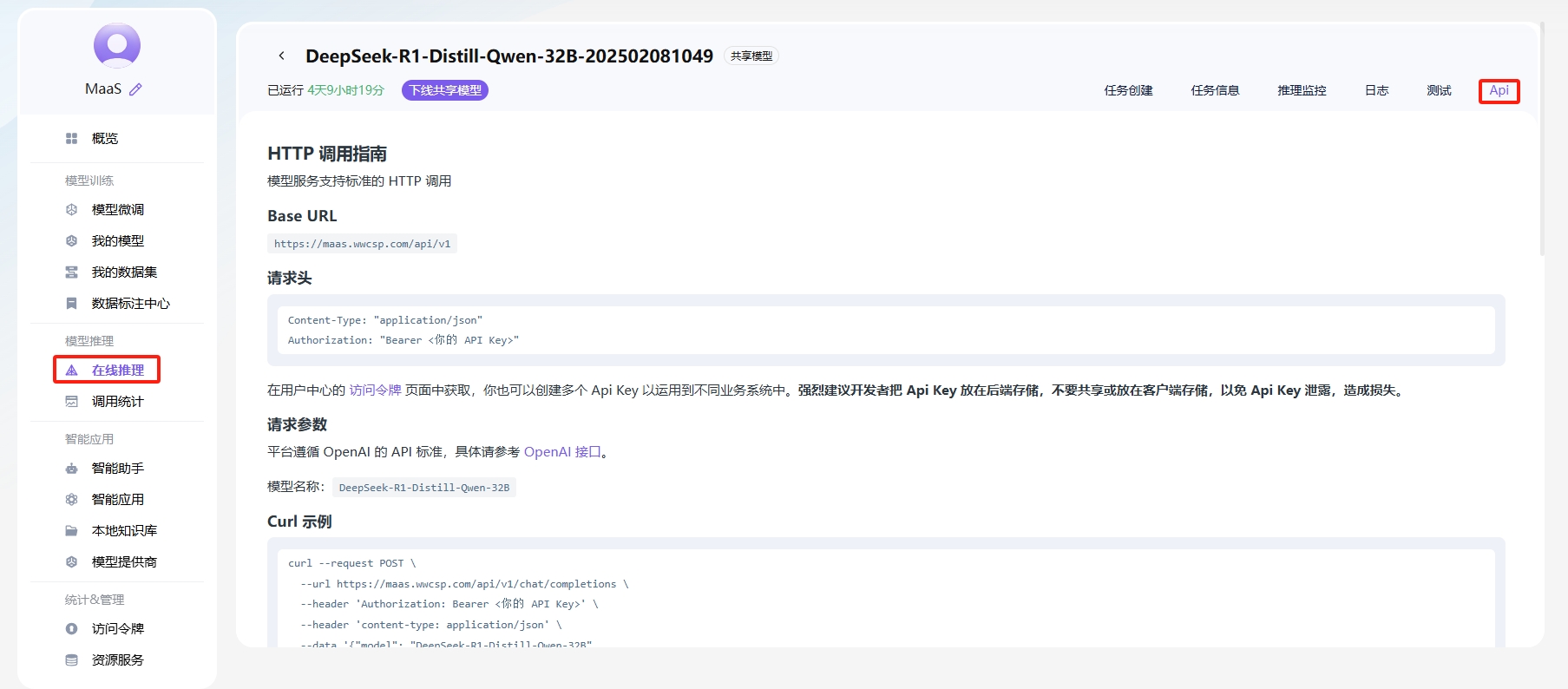

👉开发接入